ChatGPT est l’un des nouveaux outils les plus brillants alimentés par l’IA, mais les algorithmes qui travaillent en arrière-plan alimentent en fait toute une série d’applications et de services depuis 2020. Pour comprendre le fonctionnement de ChatGPT, nous devons donc commencer par parler du moteur linguistique sous-jacent qui l’alimente.

Le GPT de ChatGPT est principalement le GPT-3, ou Generative Pre-trained Transformer 3, bien que le GPT-4 soit maintenant disponible pour les abonnés de ChatGPT Plus et sera probablement bientôt plus répandu. Les modèles GPT ont été développés par OpenAI (la société à l’origine de ChatGPT et du générateur d’images DALL-E 2), mais ils alimentent tout, des fonctions d’IA récemment publiées par Bing aux outils d’écriture tels que Jasper et Copy.ai.

En fait, la plupart des générateurs de texte d’IA disponibles à l’heure actuelle utilisent le modèle GPT-3, et proposeront probablement le modèle GPT-4 dans une prochaine étape.

ChatGPT a mis GPT-3 sous les feux de la rampe parce qu’il a rendu le processus d’interaction avec un générateur de texte IA simple et, surtout, gratuit pour tout le monde. De plus, il s’agit d’un chatbot, et les gens aiment les bons chatbots depuis SmarterChild.

Si GPT-3 et GPT-4 sont actuellement les modèles de langage les plus populaires, la concurrence risque de s’intensifier au cours des prochaines années. Google, par exemple, vient de dévoiler Bard, son chatbot d’IA, qui est alimenté par son propre moteur de langage appelé Modèle de langage pour les applications de dialogue (LaMDA). Mais pour l’instant, l’offre d’OpenAI est la norme de facto de l’industrie. C’est tout simplement l’outil le plus facile à utiliser.

👉🏼 Lecture complémentaire : L’intelligence artificielle peut-elle changer la façon dont nous négocions avec les crypto-monnaies ?

La réponse à la question “comment fonctionne ChatGPT ?” est donc essentiellement la suivante : GPT-3 et GPT-4. Mais creusons un peu plus loin.

Qu’est-ce que ChatGPT ?

ChatGPT est une application développée par OpenAI. En utilisant les modèles de langage GPT, elle peut répondre à vos questions, écrire des textes, rédiger des courriels, tenir une conversation, expliquer le code dans différents langages de programmation, traduire le langage naturel en code, et plus encore – ou du moins essayer de le faire – tout cela en se basant sur les messages en langage naturel que vous lui donnez. C’est un chatbot, mais un chatbot vraiment, vraiment bon.

Bien qu’il soit intéressant de jouer avec ce système si, par exemple, vous voulez écrire un sonnet de Shakespeare sur votre animal de compagnie ou obtenir quelques idées de lignes d’objet pour des courriels de marketing, c’est également bon pour OpenAI. C’est un moyen d’obtenir beaucoup de données de la part d’utilisateurs réels et de servir de démo pour la puissance de GPT, qui pourrait autrement sembler un peu floue à moins que vous ne soyez profondément dans l’apprentissage de la machine.

Pour l’instant, ChatGPT propose deux modèles GPT. Le modèle par défaut, GPT-3.5, est moins puissant mais accessible à tous gratuitement. Le modèle GPT-4, plus avancé, est réservé aux abonnés de ChatGPT Plus, et même eux ne reçoivent qu’un nombre limité de questions chaque jour.

L’une des principales caractéristiques de ChatGPT est qu’il peut se souvenir de la conversation que vous avez avec lui. Cela signifie qu’il peut glaner du contexte à partir de ce que vous lui avez demandé précédemment et l’utiliser pour informer sa conversation avec vous. Vous pouvez également lui demander de retravailler ou de corriger un texte, et elle se référera à ce dont vous avez discuté auparavant. L’interaction avec l’IA ressemble ainsi à un véritable va-et-vient.

Si vous voulez vraiment vous faire une idée, passez cinq minutes à jouer avec ChatGPT (c’est gratuit !), puis revenez lire son mode de fonctionnement.

Comment fonctionne ChatGPT ?

Cet énorme ensemble de données a été utilisé pour former un réseau neuronal d’apprentissage profond […] modelé sur le cerveau humain, ce qui a permis à ChatGPT d’apprendre des modèles et des relations dans les données textuelles […] prédisant quel texte devrait suivre dans n’importe quelle phrase donnée.

ChatGPT tente de comprendre votre demande et émet ensuite des chaînes de mots qui, selon lui, répondront le mieux à votre question, sur la base des données sur lesquelles il a été formé.

Parlons un peu de cette formation. Il s’agit d’un processus au cours duquel l’IA naissante reçoit des règles de base, puis est mise en situation ou reçoit un grand nombre de données à traiter afin de développer ses propres algorithmes.

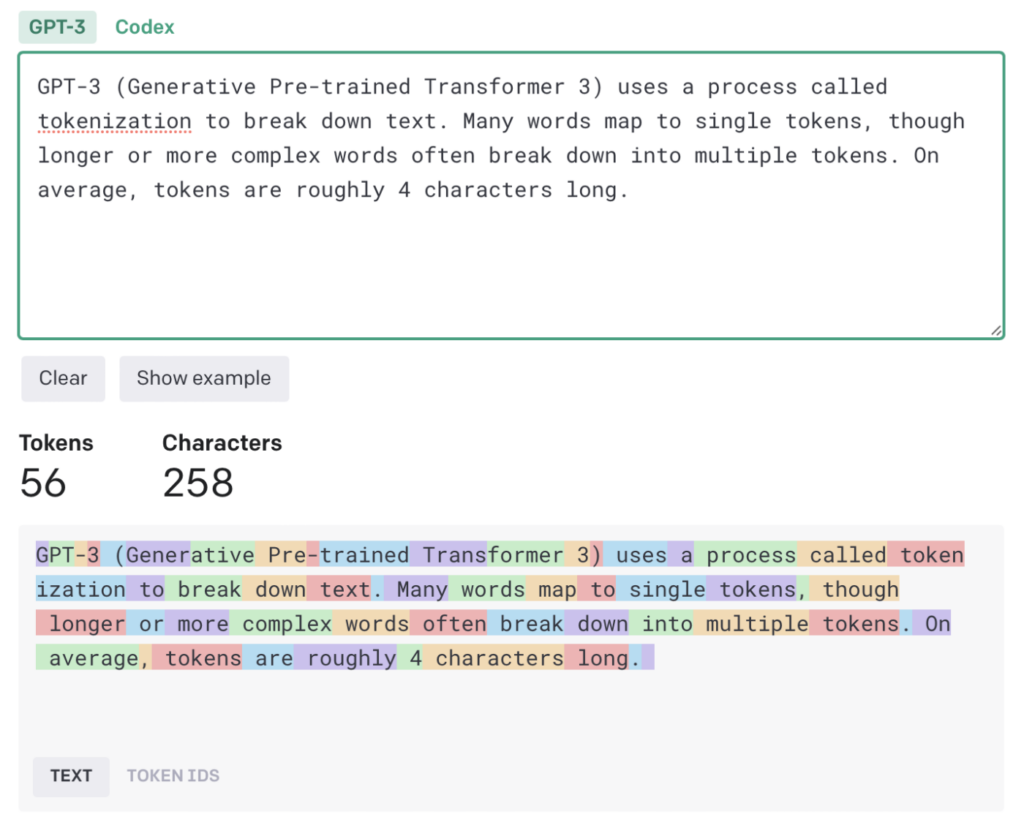

Le GPT-3 a été entraîné sur environ 500 milliards de “tokens”, qui permettent à ses modèles de langage d’attribuer plus facilement un sens et de prédire un texte ultérieur plausible.

De nombreux mots correspondent à un seul jeton, mais les mots plus longs ou plus complexes se décomposent souvent en plusieurs jetons. En moyenne, les tokens ont une longueur d’environ quatre caractères. OpenAI est restée discrète sur le fonctionnement interne de GPT-4, mais nous pouvons supposer qu’il a été entraîné sur le même ensemble de données, puisqu’il est encore plus puissant.

👉🏼 Lecture complémentaire : Découvrez Midjourney AI Art : Combiner la puissance de l’IA et la créativité d’un artiste

Tous les jetons proviennent d’un corpus massif de données écrites par des humains. Il s’agit de livres, d’articles et d’autres documents portant sur des sujets, des styles et des genres différents, ainsi que d’une quantité incroyable de contenu récupéré sur l’internet. En gros, il a été autorisé à parcourir la somme totale des connaissances humaines.

Cet énorme ensemble de données a été utilisé pour former un réseau neuronal d’apprentissage profond – un algorithme complexe, à plusieurs niveaux et pondéré, modelé sur le cerveau humain – qui a permis à ChatGPT d’apprendre des modèles et des relations dans les données textuelles et d’exploiter la capacité de créer des réponses semblables à celles des humains en prédisant quel texte devrait suivre dans n’importe quelle phrase donnée.

Mais en réalité, cela sous-estime grandement les choses. ChatGPT ne travaille pas au niveau de la phrase – il génère plutôt un texte de mots, de phrases et même de paragraphes ou de strophes qui pourraient suivre. Ce n’est pas le texte prédictif de votre téléphone qui devine le mot suivant, c’est une tentative de créer des réponses cohérentes à n’importe quelle question.

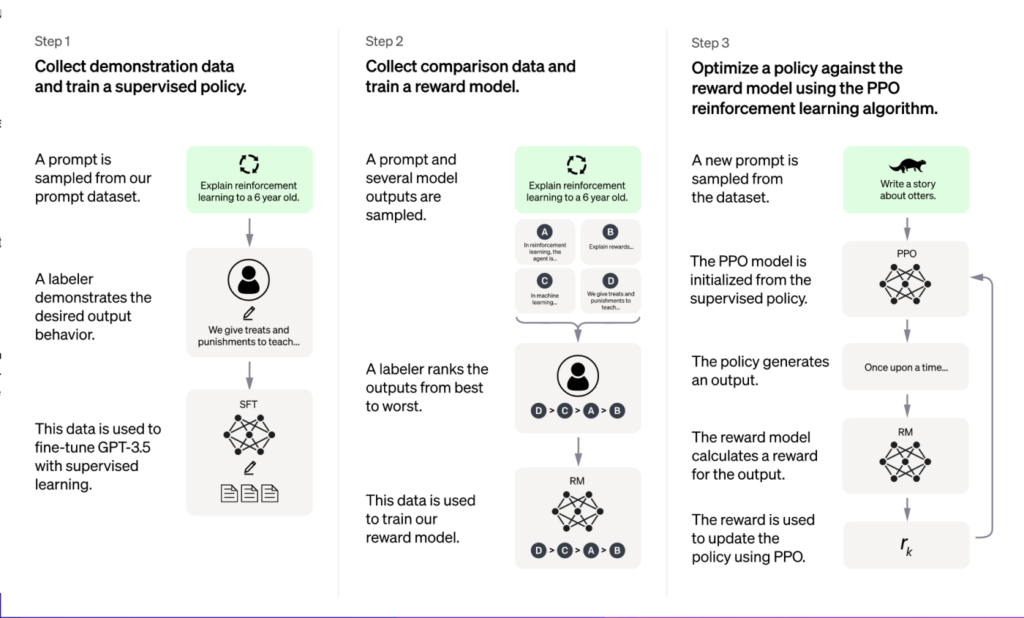

Afin d’améliorer encore la capacité de ChatGPT à répondre à une variété d’invites, il a été optimisé pour le dialogue à l’aide d’une technique appelée apprentissage par renforcement avec retour d’information humain (RLHF). Essentiellement, les humains ont créé un modèle de récompense avec des données de comparaison (où deux ou plusieurs réponses de modèles ont été classées par les formateurs de l’IA), afin que l’IA puisse apprendre quelle était la meilleure réponse.

Revenons au réseau neuronal qu’il a formé. Grâce à tout cet entraînement, le réseau neuronal de GPT-3 dispose de 175 milliards de paramètres ou variables qui lui permettent de prendre une entrée – votre requête – puis, en fonction des valeurs et des pondérations qu’il attribue aux différents paramètres (et d’une petite part d’aléatoire), de produire ce qu’il pense correspondre le mieux à votre demande.

OpenAI n’a pas précisé le nombre de paramètres de GPT-4, mais on peut supposer qu’il est supérieur à 175 milliards et inférieur aux 100 billions de paramètres évoqués précédemment. Quel que soit le nombre exact, plus de paramètres n’est pas automatiquement synonyme de meilleure qualité.

L’augmentation de la puissance du GPT-4 est probablement due en partie au fait qu’il possède plus de paramètres que le GPT-3, mais une grande partie est probablement due aux améliorations apportées à la façon dont il a été entraîné.

Cracher des mots, pas des connaissances :

Les concepteurs de ChatGPT sont les premiers à reconnaître qu’il peut produire des informations incorrectes (voire nuisibles), bien qu’ils s’efforcent d’y remédier.

En voici un exemple. Lorsque j’ai demandé à ChatGPT utilisant GPT-3 et GPT-4 de répondre à “Harry Guinness est…” GPT-3 a d’abord répondu en demandant quel Harry Guinness. Excellente question – nous sommes littéralement deux ! J’ai donc répondu “Harry Guinness l’écrivain” (c’est moi). GPT-4 a tout de suite deviné qui j’étais, mais les deux réponses étaient fascinantes :

GPT-3 : Harry Guinness est un écrivain et journaliste indépendant basé en Irlande. Il a écrit pour diverses publications, dont le New York Times, le Guardian, le Huffington Post et Popular Mechanics. Il couvre des sujets allant de la technologie et de la photographie aux voyages et à la culture.

GPT-4 : Harry Guinness est un écrivain, photographe et expert en technologie irlandais. Il a écrit pour diverses publications, dont How-To Geek, Lifehacker et Tuts+. Son travail porte principalement sur la technologie, les tutoriels et les conseils, ainsi que sur la photographie et la retouche d’images. Guinness s’est forgé une réputation en créant des guides détaillés qui aident les lecteurs à comprendre des sujets complexes ou à résoudre des problèmes de manière simple.

La première et la dernière ligne de GPT-3 sont tirées presque mot pour mot de mes différents sites web et biographies d’auteur sur le web (bien que je me présente normalement comme un écrivain et un photographe indépendant, et non comme un journaliste). En revanche, la liste des publications est pratiquement inventée. J’ai écrit pour le New York Times, mais pas pour le Guardian, le Huffington Post ou Popular Mechanics (j’écris régulièrement pour Popular Science, ce qui pourrait expliquer cette affirmation).

GPT-4 fait bien la part des choses en ce qui concerne les photographes et énumère les publications pour lesquelles j’ai écrit, ce qui est impressionnant, même si ce ne sont pas celles dont je serais le plus fier. C’est un excellent exemple de la façon dont OpenAI a pu augmenter la précision de GPT-4 par rapport à GPT-3, même s’il n’offre pas toujours la réponse la plus correcte.

Mais revenons à GPT-3, car son erreur fournit un exemple intéressant de ce qui se passe dans les coulisses de ChatGPT. En fait, il ne sait rien de moi. Il ne fait même pas de copier/coller à partir d’Internet et ne fait pas confiance à la source de l’information. Au lieu de cela, il prédit simplement une série de mots qui viendront ensuite en se basant sur les milliards de points de données dont il dispose.

En voici un exemple : Le New York Times est beaucoup plus souvent regroupé avec le Guardian et le Huffington Post qu’avec les sites pour lesquels j’ai écrit, comme Wired, Outside, The Irish Times et, bien sûr, Zapier. Ainsi, lorsqu’il doit déterminer ce qui doit suivre le New York Times, il ne s’appuie pas sur les informations publiées à mon sujet, mais sur toutes les données d’entraînement qu’il possède sur cette liste de grandes publications. C’est très astucieux et cela semble plausible, mais ce n’est pas vrai.

GPT-4 fait un bien meilleur travail et mentionne les publications, mais le reste de ce qu’il dit ne ressemble qu’à des phrases plausibles. Je ne pense pas qu’il ait une grande appréciation de ma réputation : il dit simplement le genre de choses que l’on dit dans une biographie. Elle dissimule beaucoup mieux son fonctionnement que GPT-3, bien qu’elle utilise en fait à peu près la même technique.

Néanmoins, il est très impressionnant de voir à quel point GPT s’est déjà amélioré. Pour l’instant, GPT-4 est bloqué derrière un abonnement premium, de sorte que la plupart des contenus de ChatGPT que vous verrez s’appuieront sur GPT-3, mais cela pourrait changer dans les mois à venir. Qui sait ce que GPT-5 apportera.

À Lire Aussi :

- Apple doit-il tourner la page Tim Cook ? Un cabinet d’analyse pousse au changement

- Menace de Trump : les producteurs français de vin et de fromage redoutent une hausse des tarifs douaniers américains

- Qu’est-ce qu’un Labubu ? Et pourquoi tout le monde en veut un ?

- Pourquoi faut-il d’abord structurer la fonction financière avant de faire croître son entreprise ?

- Comment créer et faire croître rapidement une entreprise : le guide en 13 étapes clés

Sylvere Gelien est un Consultant en Marketing Digital & Stratégie eCommerce chez @Search Engine Spot